A IA obtém conhecimento de três camadas distintas: dados de treinamento, sistemas de recuperação e acesso a ferramentas em tempo real, como APIs e MCPs.

Cada camada de dados tem seus próprios prós e contras, então, se você já se perguntou por que uma IA lhe disse algo errado com segurança, por que uma ferramenta parece saber sobre as notícias da semana passada e outra não, ou por que o produto do seu concorrente é mencionado toneladas enquanto o seu não, a resposta quase sempre remonta a qual camada respondeu à sua pergunta.

Este artigo é uma explicação simples de onde realmente vem o conhecimento de IA – e por que isso é importante e o quanto você deve confiar em qualquer resposta.

Antes de um modelo de IA responder a uma única pergunta, ele passa por uma fase chamada treinamento.

Durante o treinamento, o modelo ingere bilhões de textos, imagens e exemplos de código (rastreamentos públicos da Web, livros, Wikipédia, repositórios de código, bancos de dados licenciados) e aprende a prever padrões em tudo isso. Quando o treinamento termina, o modelo memorizou efetivamente um instantâneo estatístico do conhecimento humano até aquele ponto.

Uma visualização de fontes de dados comuns usadas no treinamento de grandes modelos de linguagem.

É assim que os modelos de IA desenvolvem a sua “compreensão” do mundo. A ocorrência de diferentes entidades nos dados de treinamento (como o nome de sua marca ou seus produtos: pense em “Patagônia” ou “Nanopuff Hoody”) e as palavras com as quais elas comumente ocorrem (como “ecologicamente correto” ou “alta qualidade”) moldam a compreensão que o modelo tem de sua marca.

Como explica Gianluca Fiorelli:

Os LLMs aprendem as relações entre sua marca e conceitos como ‘academia’ ou ‘cancelamento de ruído’. Essas associações semânticas influenciam diretamente se e como você é mencionado.

A escala envolvida no treinamento é quase difícil de imaginar. Os dados de treinamento para os principais modelos são medidos em trilhões de tokens (aproximadamente, pedaços de palavras). Os custos dão uma ideia do que isso exige: o treinamento do GPT-4 custa cerca de US$ 78 milhões; O Gemini Ultra do Google custa cerca de US$ 191 milhões.

O mercado global de conjuntos de dados de treinamento em IA foi US$ 3,2 bilhões em 2025, e prevê-se que atinja os 16,3 mil milhões de dólares até 2033 – uma taxa de crescimento anual de 22,6% que reflecte a forma como os dados se tornaram centrais para toda a empresa.

Aqui está o ponto crítico a ser entendido: quando o treinamento termina, o conhecimento do modelo é congelado. Não pode aprender com novos eventos. Ele não tem ideia do que aconteceu ontem, ou no mês passado, ou depois de qualquer data em que seus dados de treinamento foram cortados.

Alguns provedores ajustam periodicamente seus modelos com base em dados mais recentes, mas esse ainda é um processo discreto – mais parecido com a emissão de uma atualização de software do que com a leitura contínua de notícias.

O outro modo de falha importante é a alucinação. Quando um modelo não tem dados de treinamento confiáveis para se basear, ele preenche a lacuna com algo que parece plausível – uma citação fabricada, uma estatística inventada, uma não-resposta confiante (como a Visão geral da IA do Google citando um Artigo de sátira do Primeiro de Abril como fonte factual).

A modelo não tinha como saber que o artigo era uma piada; parecia confiável o suficiente para se ajustar ao padrão.

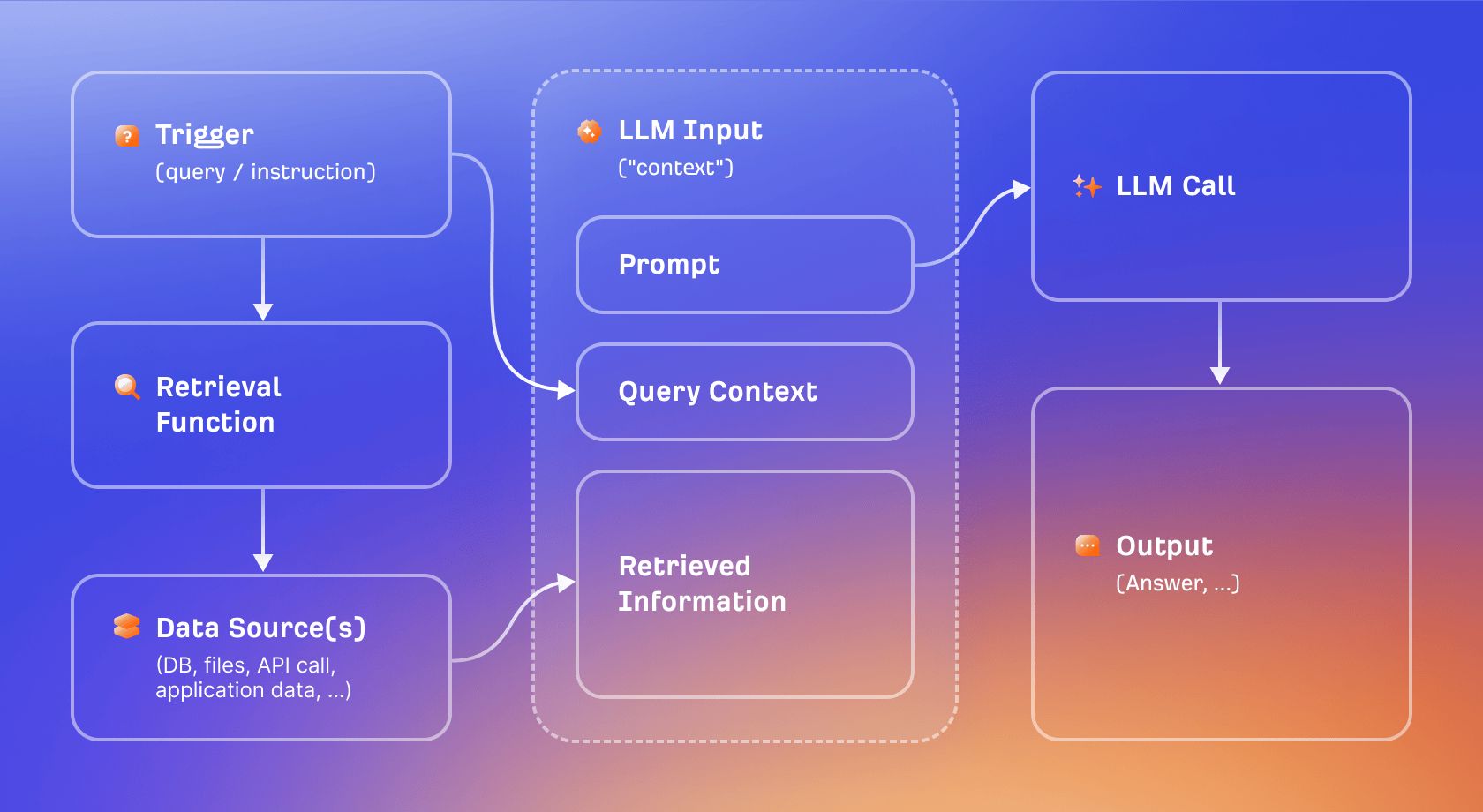

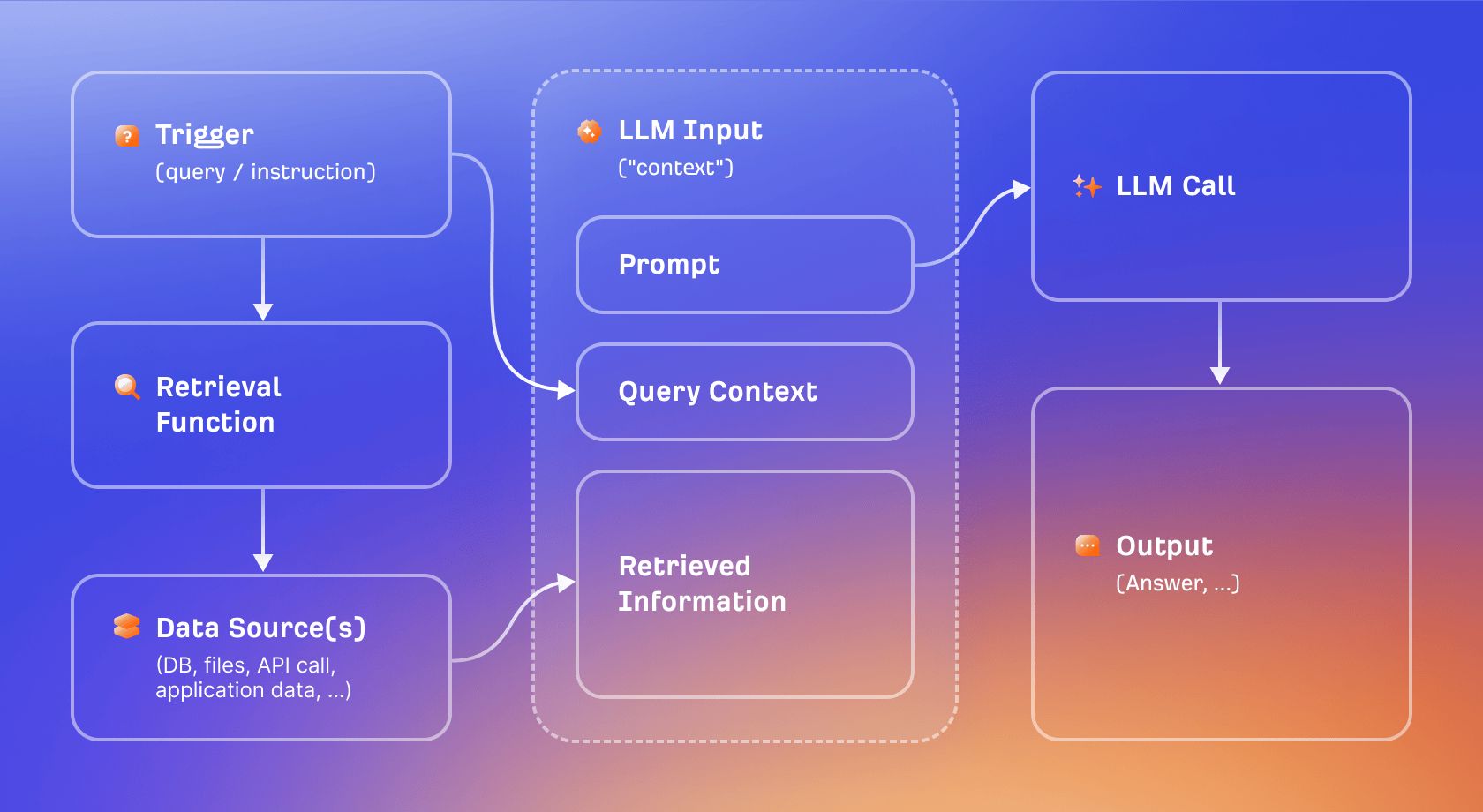

A geração aumentada de recuperação (RAG) é a principal técnica usada para contornar o problema de corte de conhecimento.

Em vez de confiar apenas no que o modelo aprendeu durante o treinamento, o RAG permite que o modelo extraia documentos relevantes no momento em que uma pergunta é feita e, em seguida, use esses documentos como contexto ao gerar uma resposta.

Pense nisso como a diferença entre um exame sem consulta e um com consulta aberta. Um modelo somente de treinamento deve responder de memória. Um modelo habilitado para RAG pode pesquisar primeiro e depois responder. O resultado é mais atual e, em princípio, mais verificável, porque a resposta se baseia no conteúdo real recuperado e não na correspondência estatística de padrões.

Geração aumentada de recuperação visualizada.

“Aterramento” é o termo mais amplo para esta ancoragem. Quando uma resposta de IA é fundamentada, ela fica vinculada a fontes recuperadas específicas, o que reduz drasticamente o risco de alucinação.

Como explica Britney Muller:

A fundamentação vem da verdade básica, enraizada nas estatísticas e originalmente na cartografia, onde literalmente significava sair para verificar se o seu mapa correspondia à realidade.

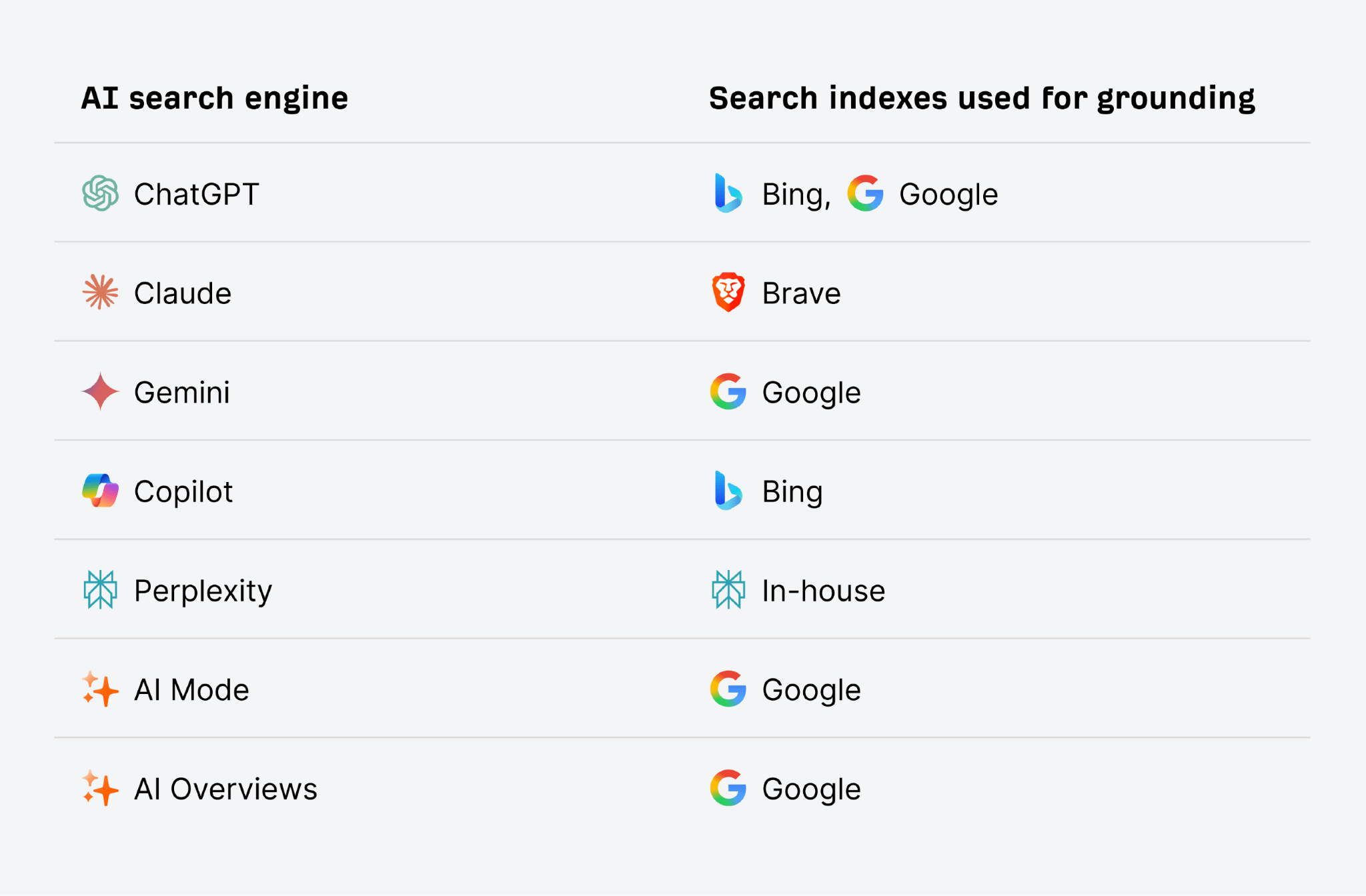

Mecanismos de busca de IA como ChatGPT e Gemini usam índices de busca tradicionais como Google e Bing para esse processo de fundamentação. É por isso que um bom SEO e uma classificação elevada na pesquisa tradicional também melhorarão a visibilidade da sua IA. Quanto mais alto você aparecer no índice de pesquisa para o termo que a IA procura, maior será sua chance de ser recuperado e citado na resposta.

Nem todo produto de IA usa RAG. Uma sessão básica do ChatGPT com navegação desabilitada, por exemplo, é puramente baseada em treinamento: ela não tem acesso às informações atuais e não tem como verificar suas respostas em fontes ao vivo.

A compensação é velocidade e simplicidade. As respostas somente de treinamento são rápidas, mas estão permanentemente desatualizadas. O RAG adiciona latência e introduz um novo modo de falha (erros de recuperação – extração da fonte errada ou de baixa qualidade), mas torna possível a atualidade.

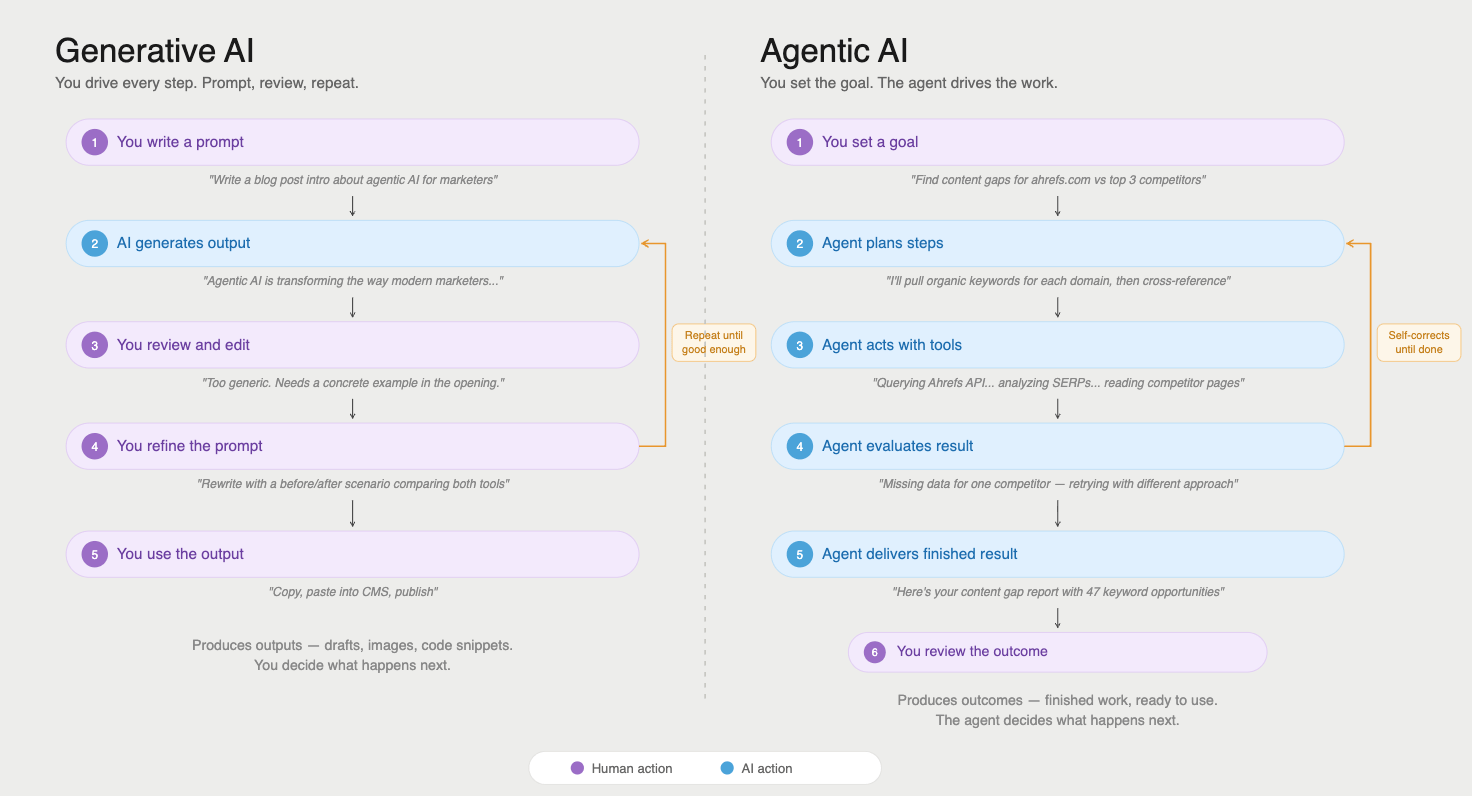

RAG é uma maneira de obter informações novas em uma resposta de IA. Mas os sistemas modernos de IA estão cada vez mais indo além, dando aos modelos a capacidade de chamar ferramentas externas no meio da conversa. Este é o território dos agentes de IA.

Um agente de IA não recupera apenas documentos; ele pode consultar APIs, executar pesquisas, executar código e interagir com fontes de dados ativas como parte do trabalho em uma tarefa.

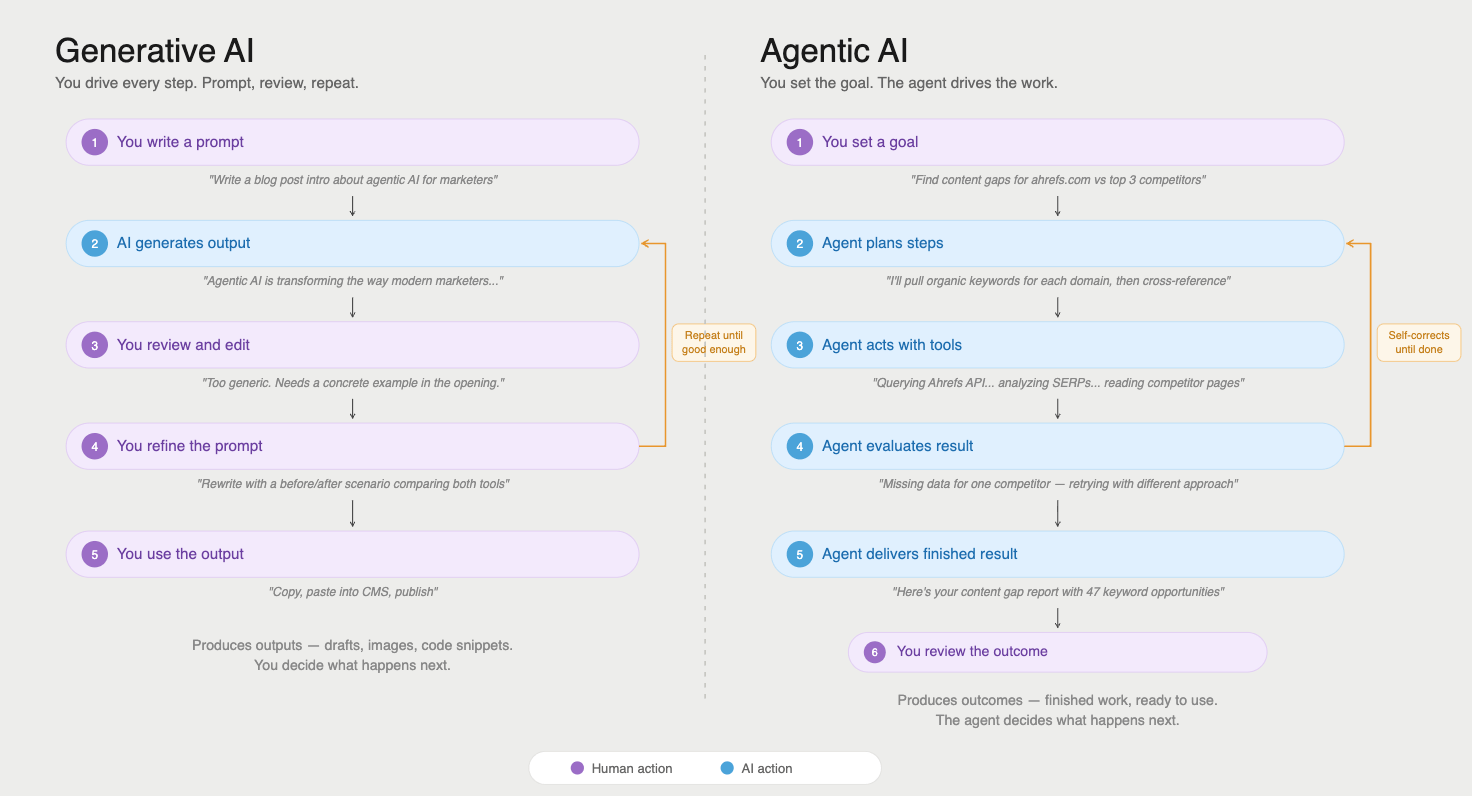

Uma comparação entre o uso de IA generativa e IA de agência.

A infra-estrutura emergente para isso é chamada Model Context Protocol (MCP), um padrão que permite que modelos de IA se conectem a fontes de dados externas de forma estruturada.

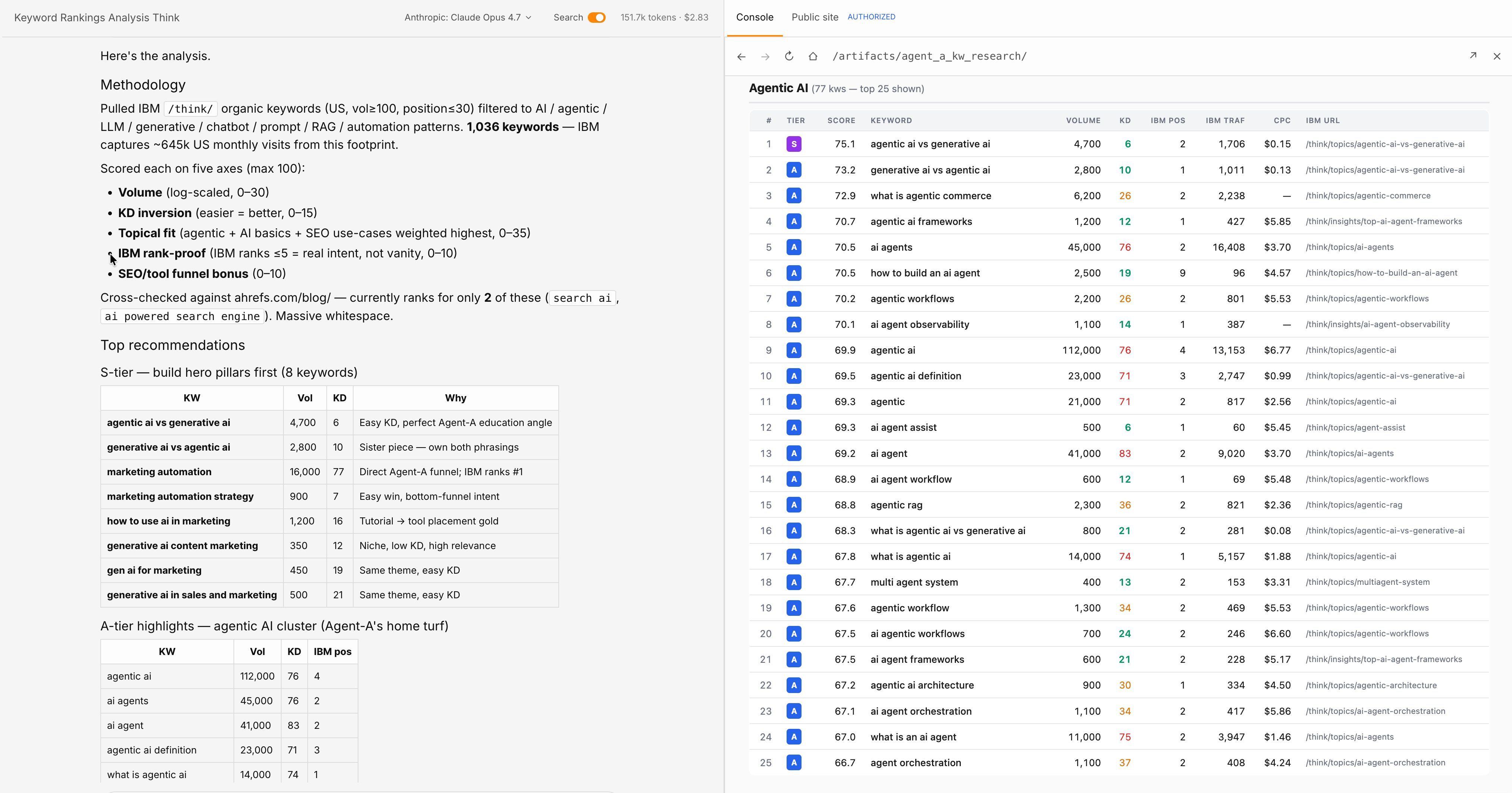

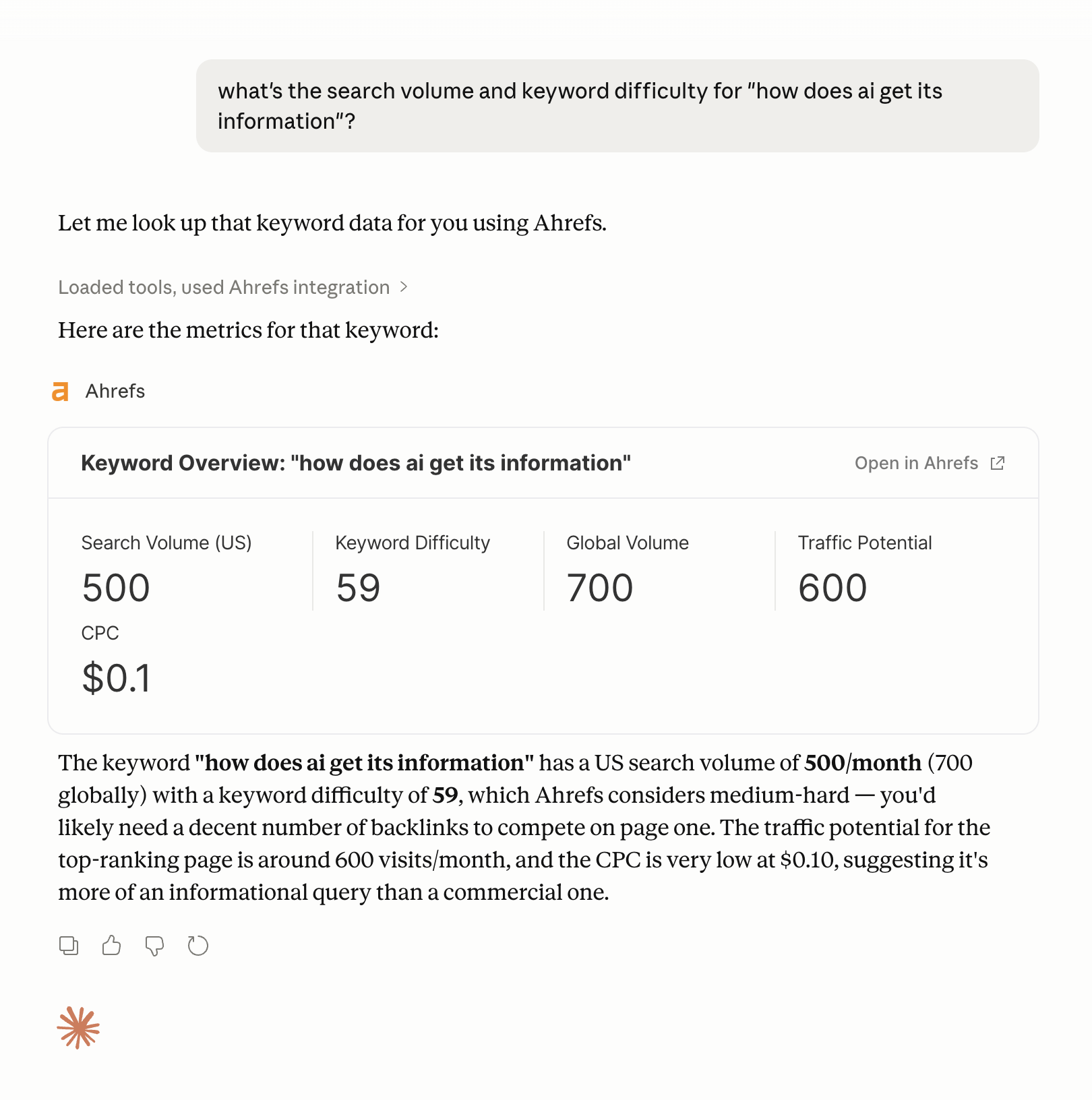

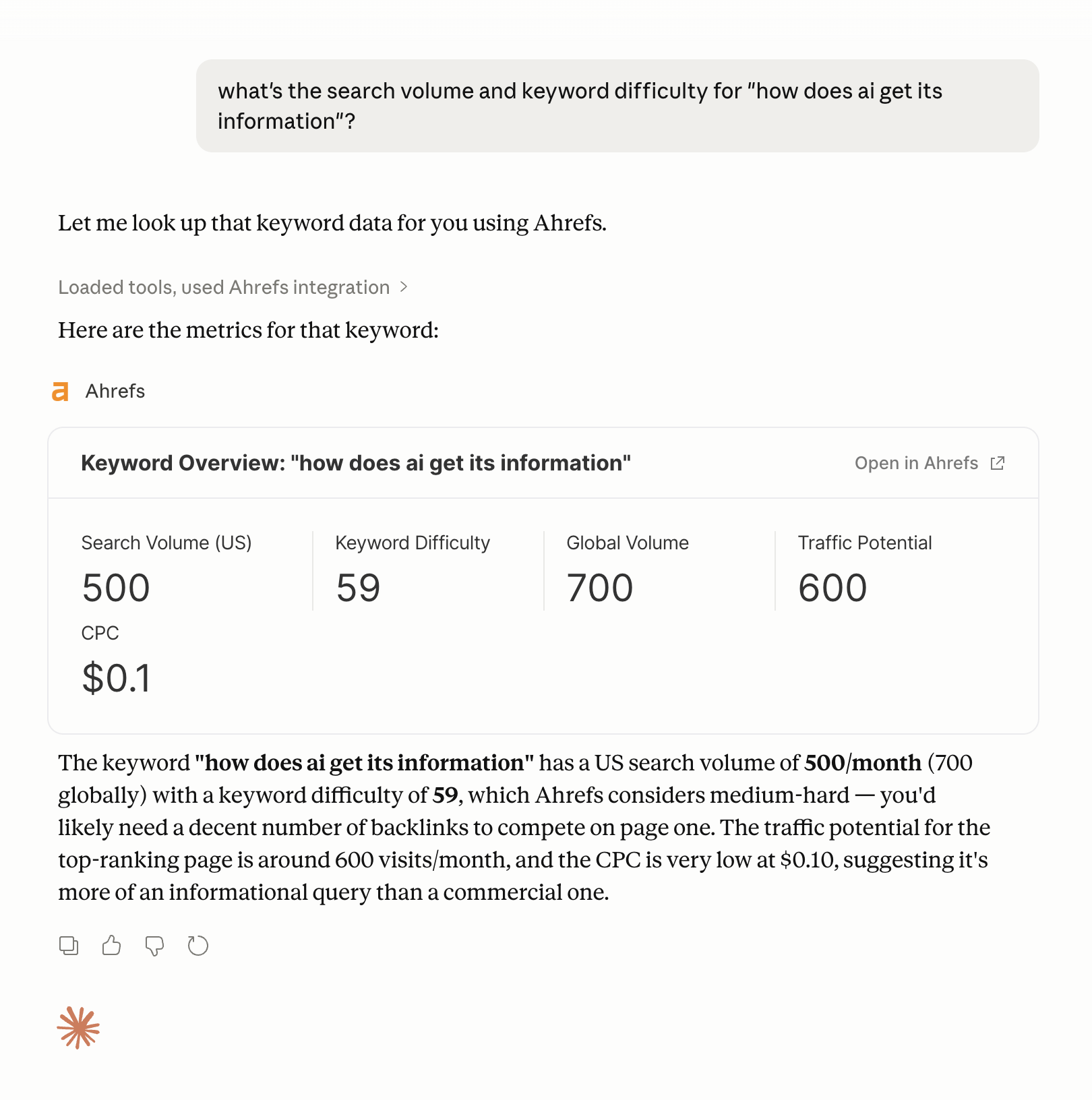

Um exemplo concreto: o Ahrefs tem uma integração MCP que permite que os agentes de IA consultem os dados do Ahrefs diretamente durante uma tarefa, obtendo métricas de palavras-chave, dados de backlinks ou insights competitivos sem que o usuário saia do fluxo de trabalho.

Um exemplo de obtenção de dados de palavras-chave usando o Ahrefs MCP em Claude.

Experimente o Agente A agora

O Agente A do Ahrefs vai além. É uma IA de marketing com acesso direto e ilimitado ao conjunto de dados interno completo do Ahrefs: dados de palavras-chave, métricas do site, inteligência competitiva, tudo bem.

Em vez de uma IA que precisa aproximar os insights de SEO dos dados de treinamento (que ficam obsoletos) ou recuperá-los de fontes públicas (que estão incompletas), o Agente A trabalha a partir dos dados reais.

Especificamente para tarefas de marketing e SEO, essa é uma grande diferença: o Agente A pode lidar com muitos fluxos de trabalho de SEO e marketing, sem qualquer ajuda.

O princípio mais amplo é que a IA aumentada por ferramentas é tão confiável quanto as ferramentas que ela chama. Se a API retornar dados incorretos, a IA produzirá uma resposta incorreta, com segurança. A inteligência do modelo não evita entradas inúteis. O que ele faz é ampliar o alcance do modelo muito além do que qualquer conjunto de dados de treinamento poderia cobrir.

Quando você entende de onde a IA obtém suas informações, você entende onde sua marca precisa aparecer para ter a melhor chance de ser citada:

- Menções fora do site. Se você deseja que a IA represente sua marca com precisão, o ponto de partida não é seu site, mas menções externas. Os modelos aprendem sobre as marcas a partir das fontes nas quais treinaram: cobertura da imprensa, análises de terceiros, discussões em fóruns, entradas da Wikipedia e citações em publicações confiáveis. Uma marca que existe apenas em seu próprio domínio é praticamente invisível aos dados de treinamento do modelo.

- Fan-out da consulta. Além do reconhecimento da marca, você precisa pensar na distribuição de consultas, as questões adjacentes que os sistemas de IA geram em torno de um tópico central. Uma classificação de marca para “software de gerenciamento de projetos” também deve ter como alvo conteúdos como “como executar uma revisão de sprint” ou “ágil versus cascata”, porque essas são as questões que um sistema de IA irá surgir quando um usuário acompanha a consulta inicial. Criar conteúdo que cubra toda a vizinhança semântica em torno de seus tópicos principais aumenta as chances de você aparecer nessa expansão.

- Acessibilidade de IA. A acessibilidade técnica também é importante. HTML limpo, tempos de carregamento rápidos e um arquivo robots.txt bem configurado afetam se os rastreadores de IA podem ler seu conteúdo. llms.txt é um padrão proposto para ajudar os LLMs a navegar na estrutura do seu site, mas em 2026 nenhum grande provedor de LLM confirmou que o respeita (portanto, não perca tempo).

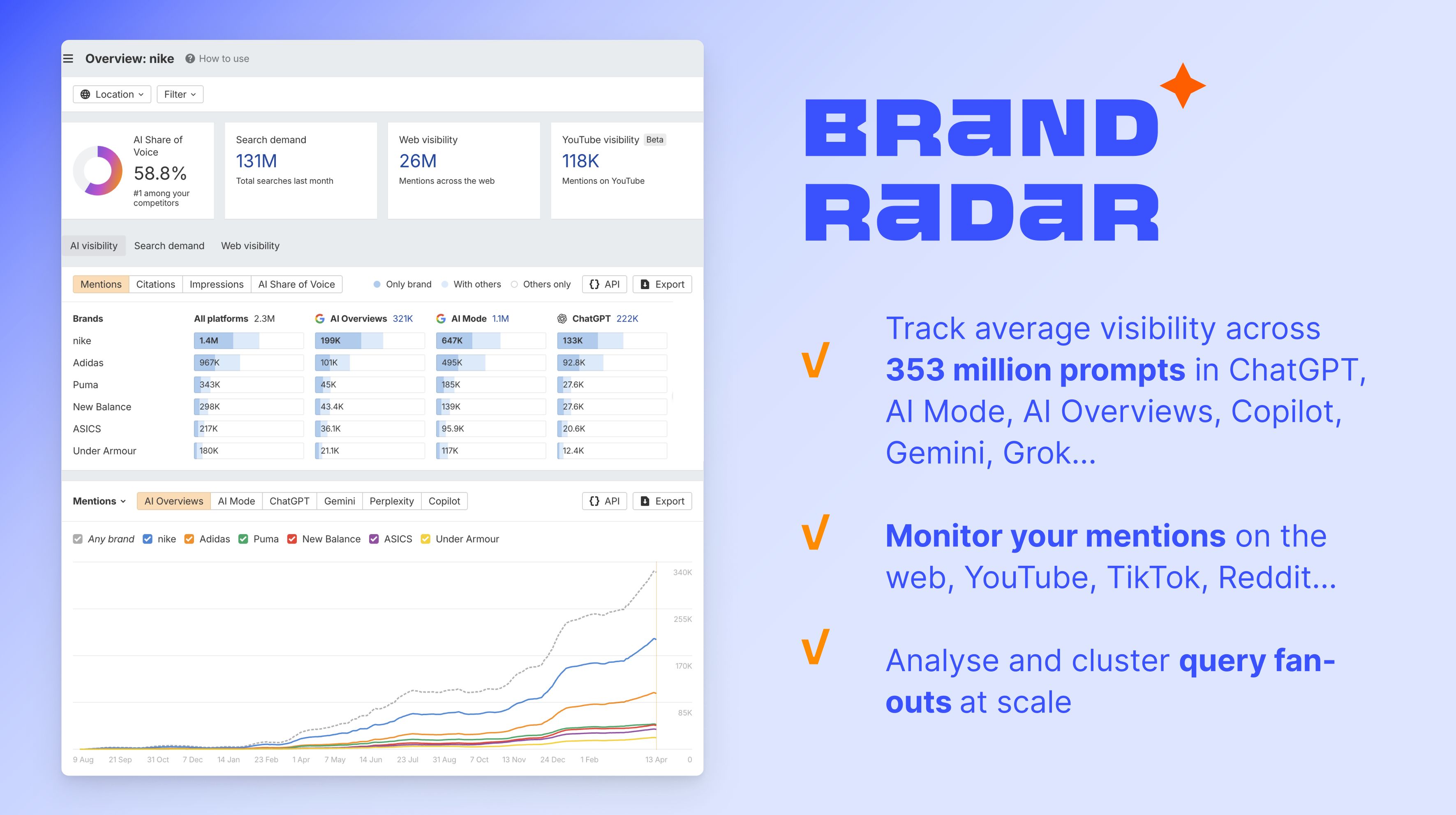

Comece a monitorar a visibilidade da IA com o Brand Radar

Para medir como isso funciona na prática, o Brand Radar do Ahrefs rastreia a participação de voz da IA em ChatGPT, Gemini, Perplexity, AI Overviews, AI Model Grok e muitos mais, mostrando com que frequência sua marca é mencionada em respostas geradas por IA em relação aos concorrentes. Leia este artigo para saber como funciona.

Considerações finais

O conhecimento de IA vem de três camadas: dados de treinamento congelados, documentos ativos recuperados e ferramentas externas conectadas, como APIs e MCPs. Cada um tem um perfil de precisão diferente, uma relação diferente com a atualidade e uma forma diferente de falhar.

Os dados de treinamento são a base – vastos, caros e estáticos. RAG e aterramento agregam valor ao custo da confiabilidade de recuperação. As integrações de ferramentas, como o MCP do Ahrefs, e agentes específicos, como o Agente A, estendem isso ainda mais, dando à IA acesso a dados oficiais e em tempo real no momento em que são necessários.

Para uma visão mais aprofundada de como os mecanismos de pesquisa de IA unem essas camadas para gerar respostas, confira nosso guia sobre como funcionam os mecanismos de pesquisa de IA.