As páginas citadas pela IA tinham quase três vezes mais probabilidade de ter JSON-LD do que as páginas não citadas.

Essa é uma grande lacuna e o tipo de estatística que é compartilhada nos carrosséis do LinkedIn e nos slides de conferências como prova de que o esquema é uma alavanca de visibilidade da IA.

Mas não ficamos satisfeitos com os dados, pois poderiam facilmente ter sido uma correlação, e não uma causa.

A marcação de esquema tende a residir em sites mais bem mantidos e tecnicamente mais sofisticados, e esses mesmos sites publicam conteúdo mais forte, constroem mais autoridade, ganham mais links e fazem todas as outras coisas que fazem com que as páginas sejam citadas.

O esquema pode estar fazendo um trabalho real, mas também pode estar apenas aproveitando a onda de todos os outros sinais.

Portanto, não poderíamos realmente responder à pergunta com a qual os SEOs realmente se preocupam: se eu adicionar um esquema à minha página, serei mais citado pela IA?

Para descobrir, realizamos um segundo estudo desenvolvido para isolar o efeito da adição de esquema.

Aqui está o que encontramos.

Rastreamos 1.885 páginas da web que adicionaram o esquema JSON-LD entre agosto de 2025 e março de 2026, comparamos-nas com 4.000 páginas de controle e medimos as mudanças de citação nas visões gerais de IA do Google, modo AI e ChatGPT.

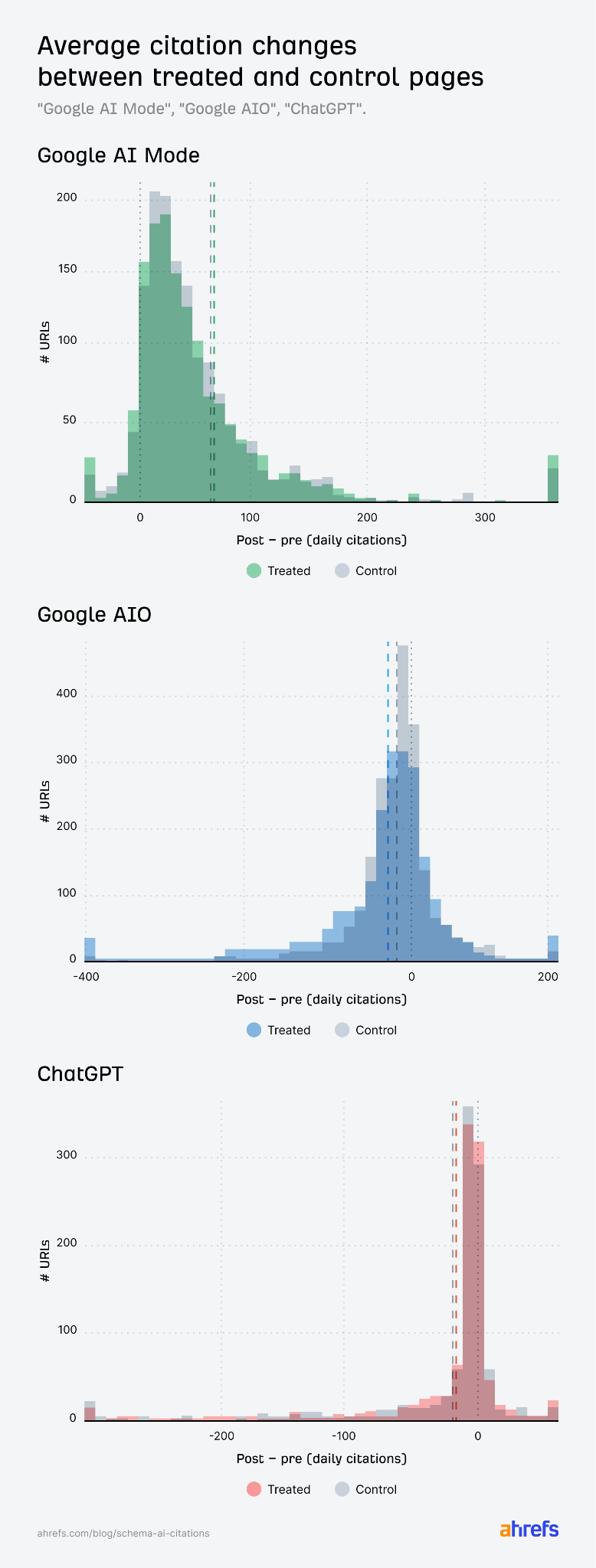

Adicionar esquema não produziu grande aumento nas citações em qualquer plataforma.

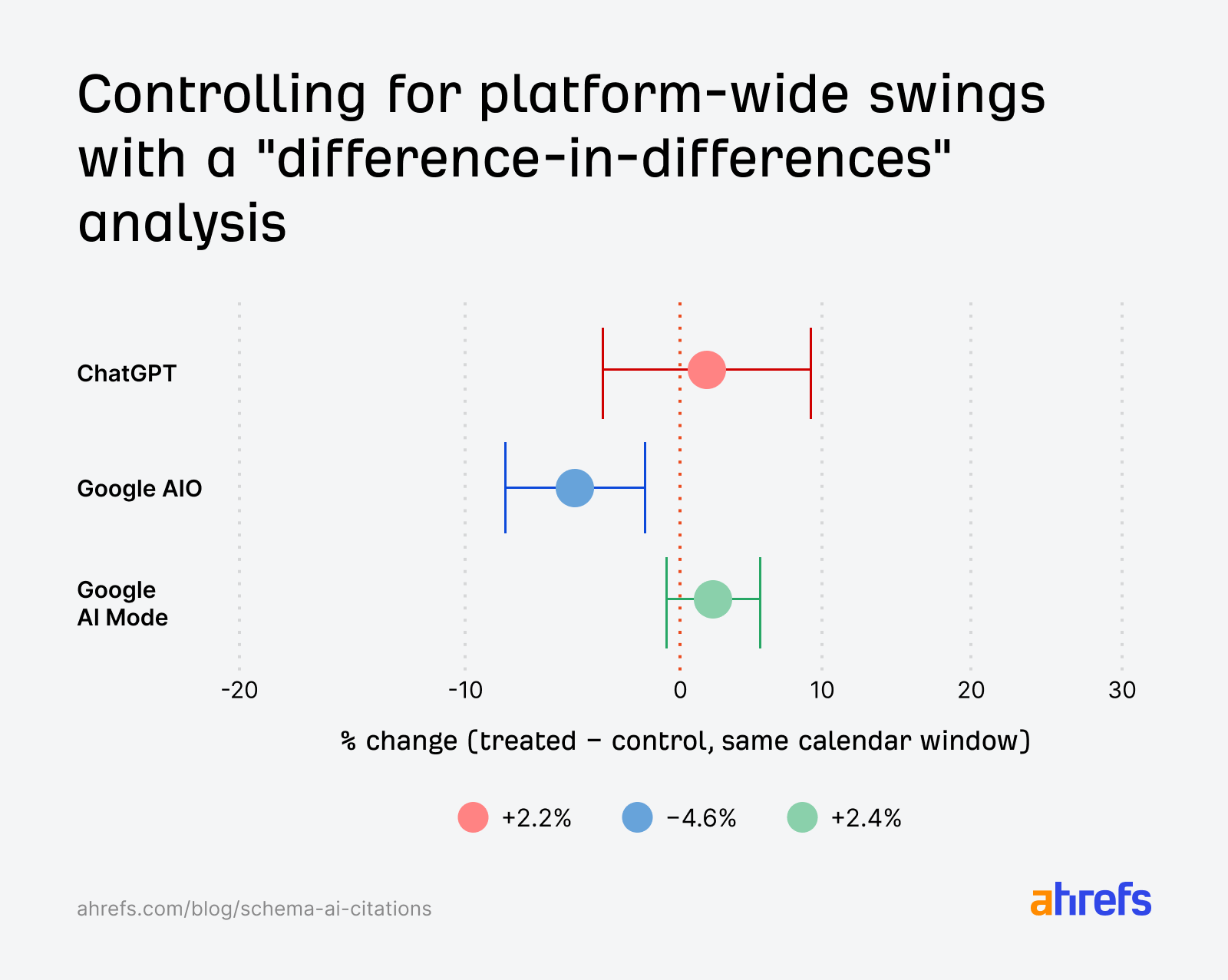

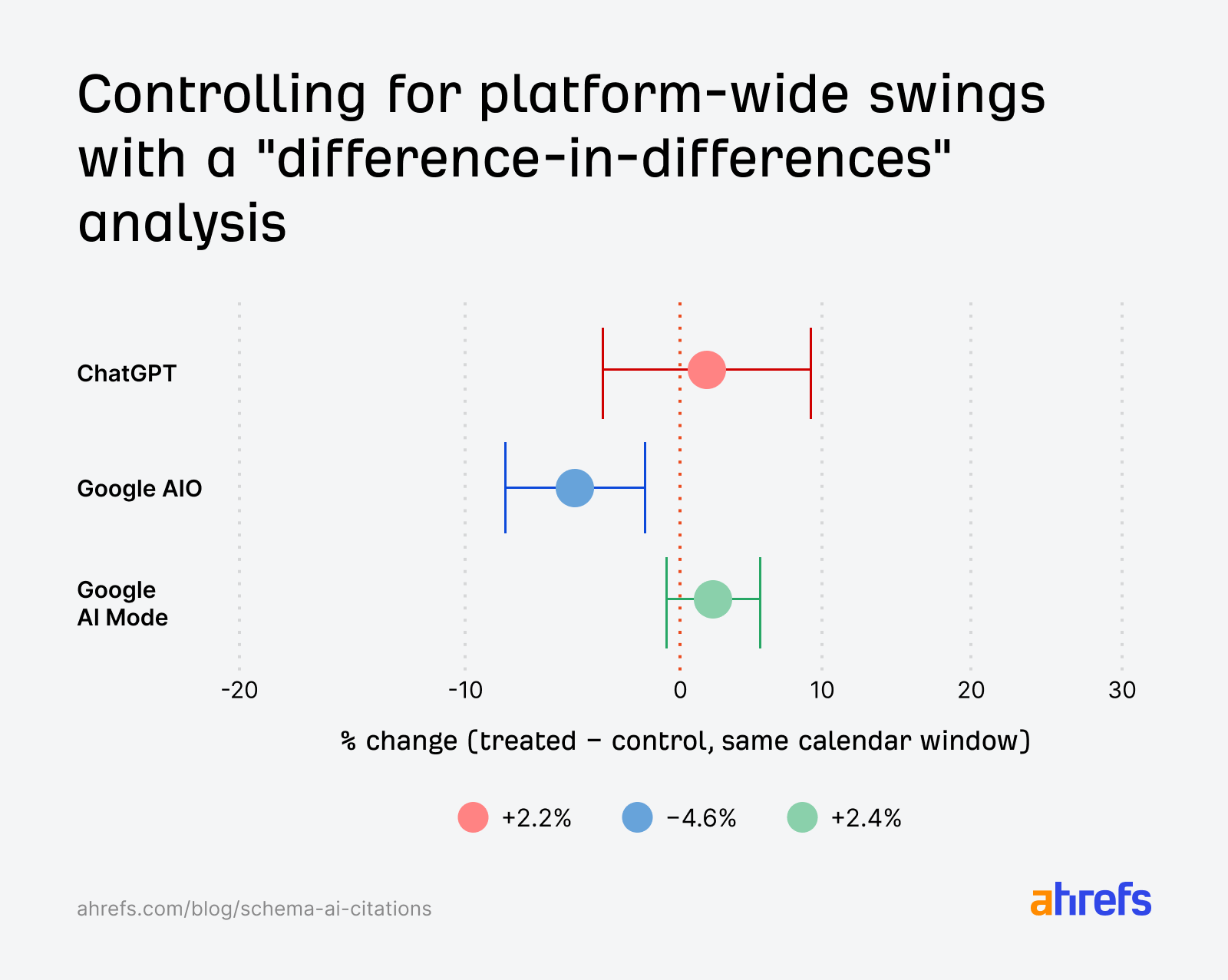

| Fonte de IA | Efeito nas citações | Veredicto |

|---|---|---|

| AIO do Google | −4,6% | Declínio pequeno, mas estatisticamente significativo, em relação aos controles correspondentes; (ambos os grupos diminuíram juntos, mas as páginas tratadas caíram um pouco mais rápido) |

| Modo IA do Google | +2,4% | Estatisticamente indistinguível de zero |

| Bate-papoGPT | +2,2% | Estatisticamente indistinguível de zero |

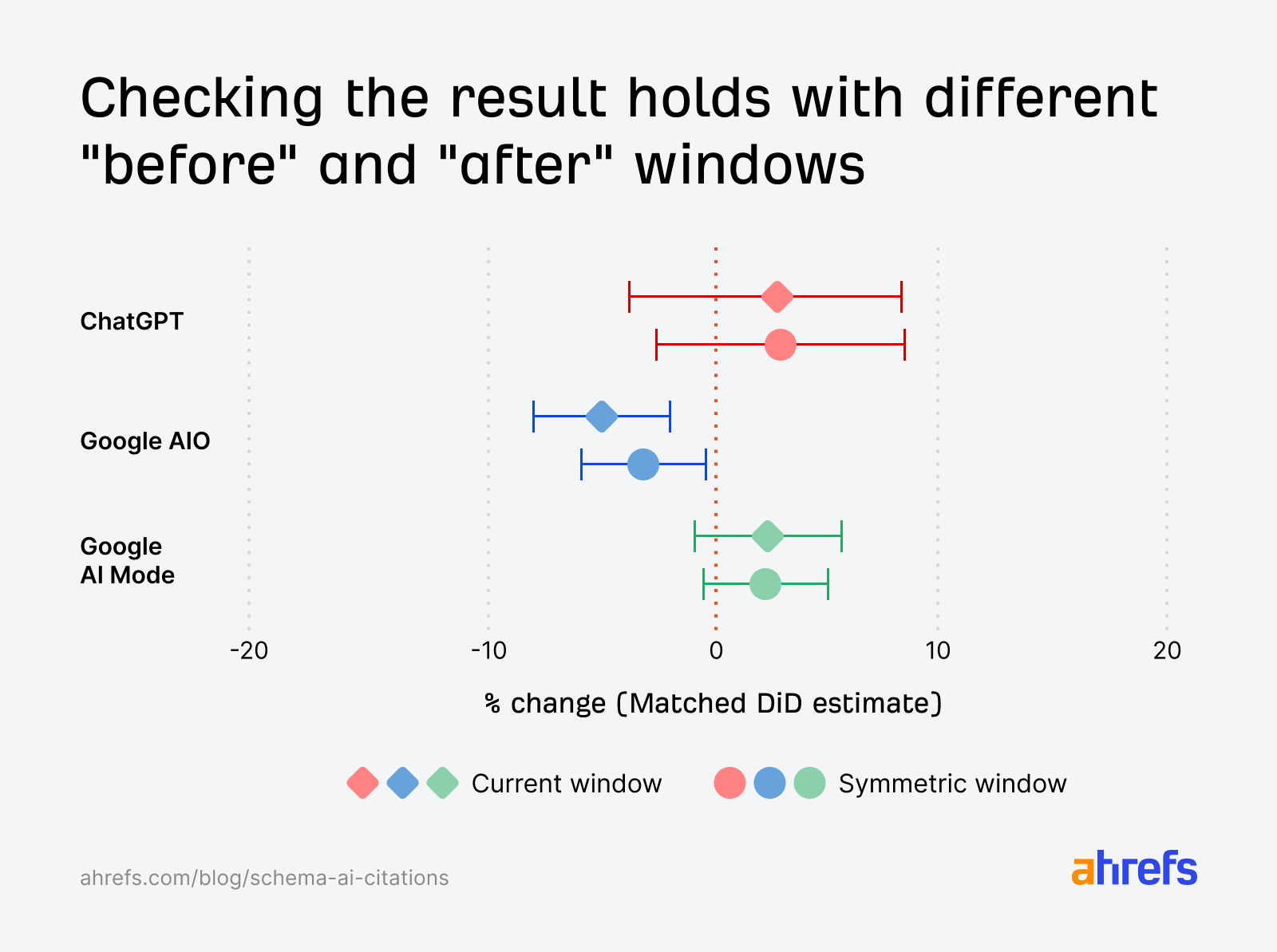

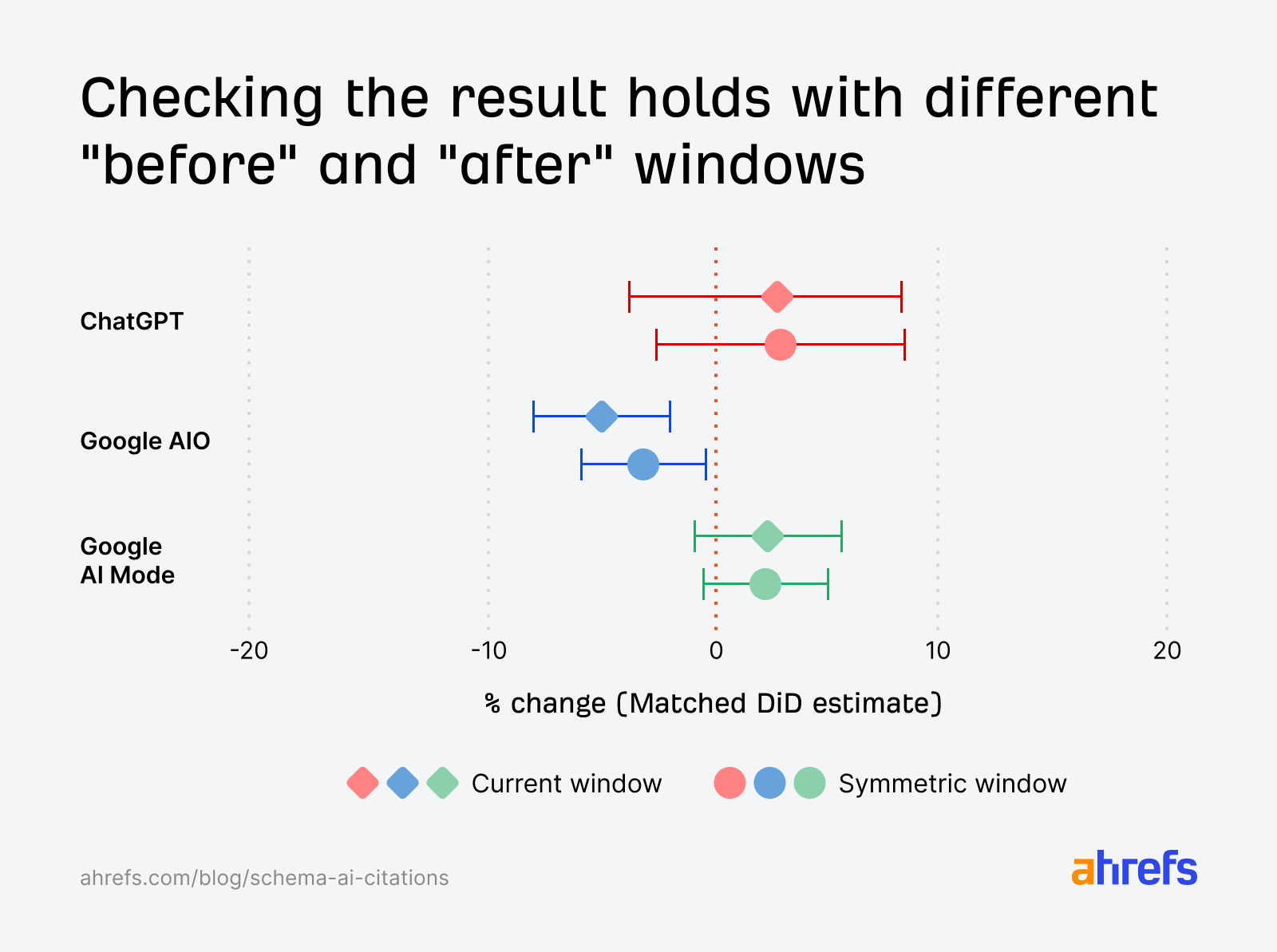

Essas porcentagens vêm de nossa análise mais confiável (uma diferença em diferenças combinadas (DiD) teste).

Neste teste, as páginas tratadas no Modo AI e no ChatGPT tiveram um desempenho ligeiramente melhor do que as páginas de controle, em média, mas as diferenças são pequenas o suficiente para que possam facilmente ser ruído aleatório em milhares de URLs.

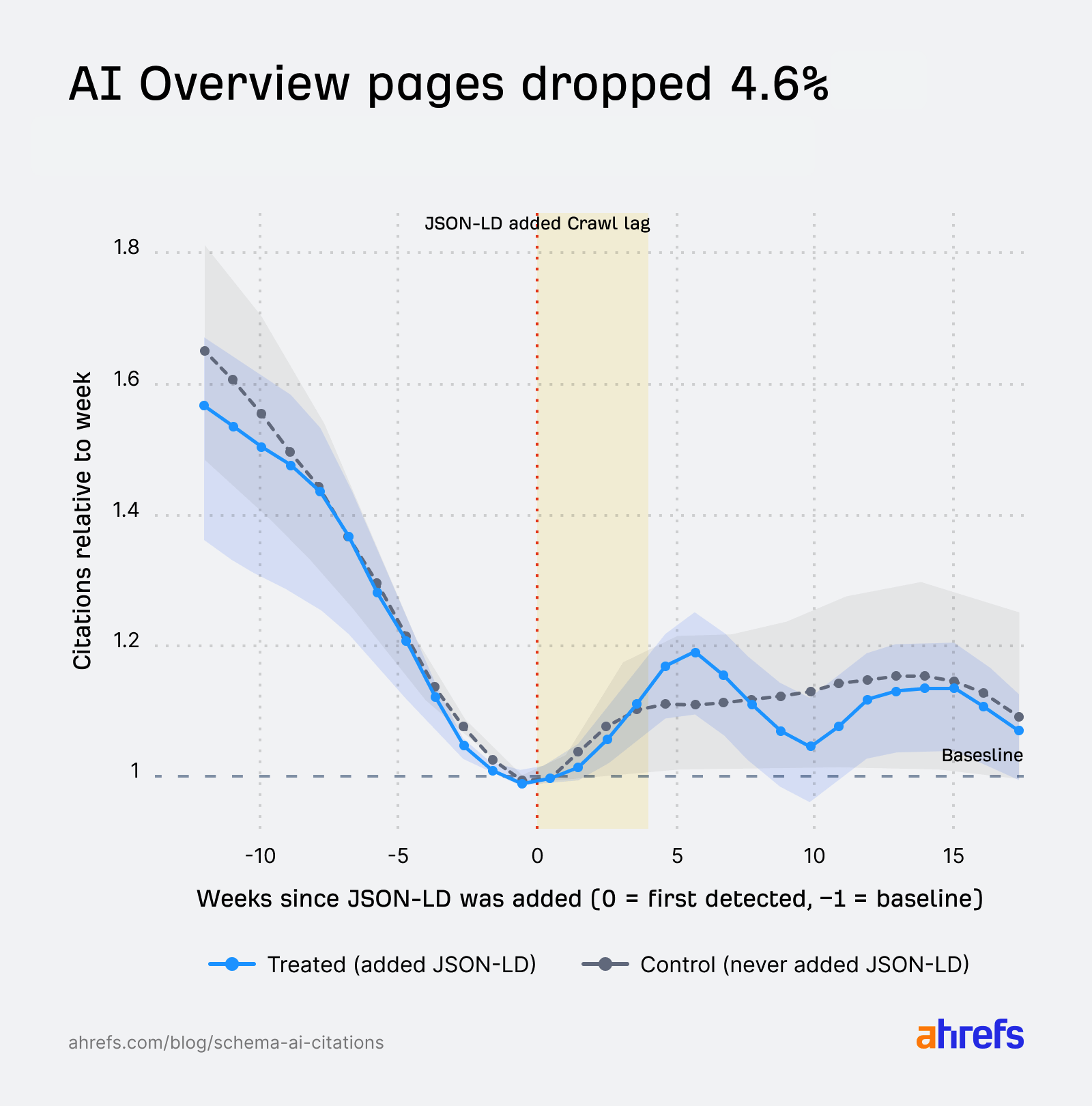

As visões gerais de IA mostraram um declínio de 4,6%, o que é pequeno, mas estatisticamente significativo em relação às páginas de controle correspondentes.

Mas essa não é toda a história – falaremos disso na próxima seção.

Portanto, no geral, não podemos dizer se o esquema fez algum bem ou nada.

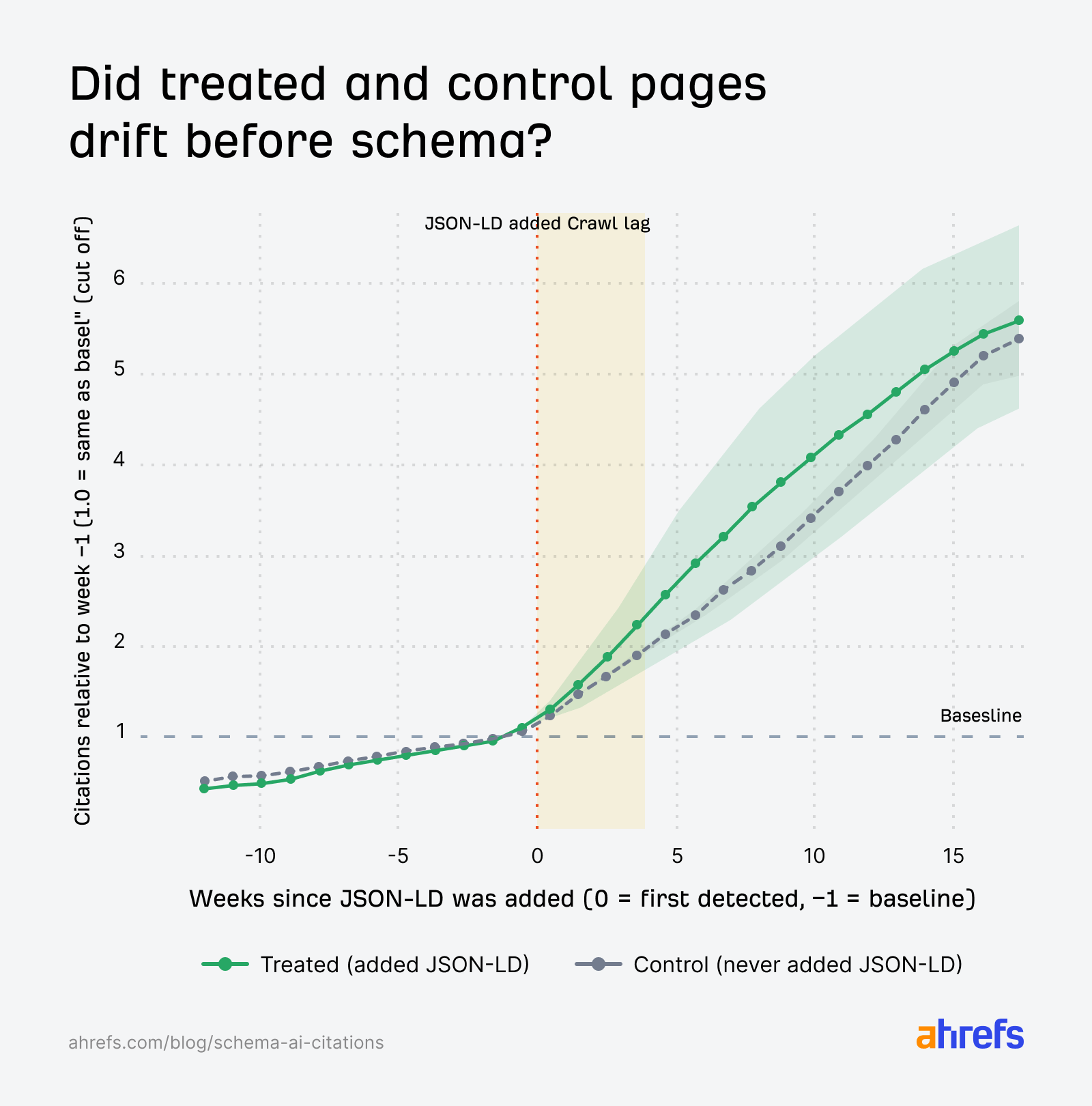

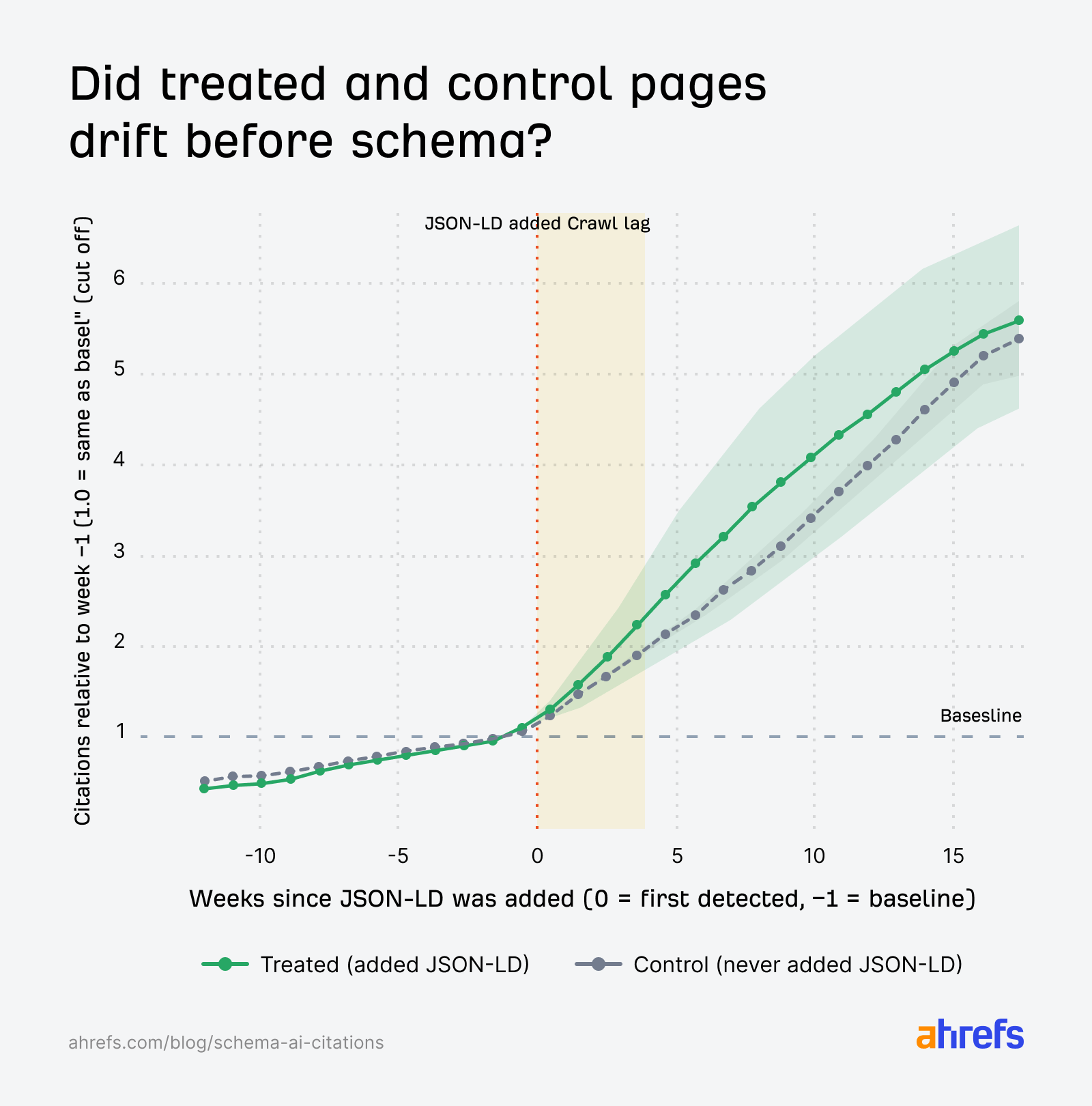

As citações do AI Overview nas páginas tratadas caíram 4,6% em relação às páginas de controle, e o resultado é “estatisticamente significativo” (as chances de ver uma lacuna tão grande por puro acaso são de cerca de 1 em 2.500).

Mas antes que alguém leia isso como “adicionar esquema prejudica suas citações de visão geral de IA”, há duas coisas que você precisa ter em mente.

- O tamanho absoluto é pequeno. Estamos falando de uma perda média de cerca de 12 citações diárias por página, em uma amostra onde a maioria das páginas recebia centenas.

- As páginas de controle tratadas e correspondentes já estavam em uma trajetória descendente acentuada antes esquema foi adicionado – o tipo de declínio que você esperaria de visões gerais de IA retirando-se desses tipos específicos de conteúdo por motivos não relacionados ao esquema (por exemplo, uma atualização do Google alterando o que aparece, o conteúdo ficando obsoleto ou o Google não tendo rastreado novamente a página recentemente).

Nota lateral.

Como ler este gráfico: ambas as linhas estão ancoradas em 1,0 na semana −1 (a semana anterior à adição do esquema), portanto, sempre começam no mesmo ponto por design. Antes do tratamento, ambos os grupos declinam juntos. Após o tratamento, as páginas tratadas ficam ligeiramente abaixo dos controles correspondentes (esta é a lacuna de -4,6%).

Dito isso, se a adição de esquema não tivesse efeito nas citações, esperaríamos que as páginas tratadas e os controles correspondentes diminuíssem juntos na mesma taxa (que é basicamente o que vemos no Modo AI e no ChatGPT).

O fato de as páginas tratadas terem diminuído um pouco mais sugere que o esquema teve um pequeno efeito negativo – mas também pode ser apenas coincidência.

Não podemos dizer qual é apenas com base nesses dados.

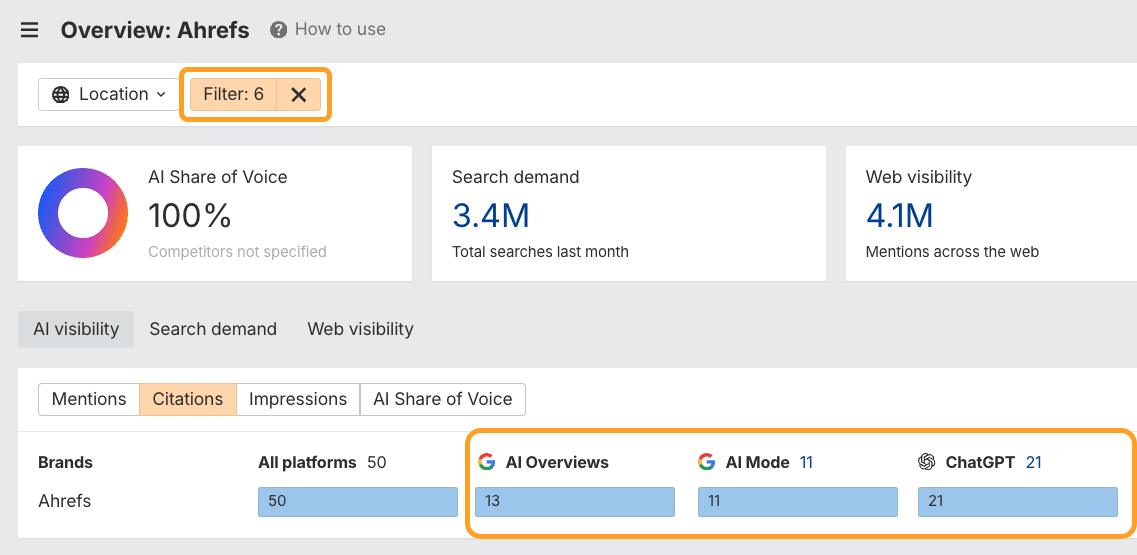

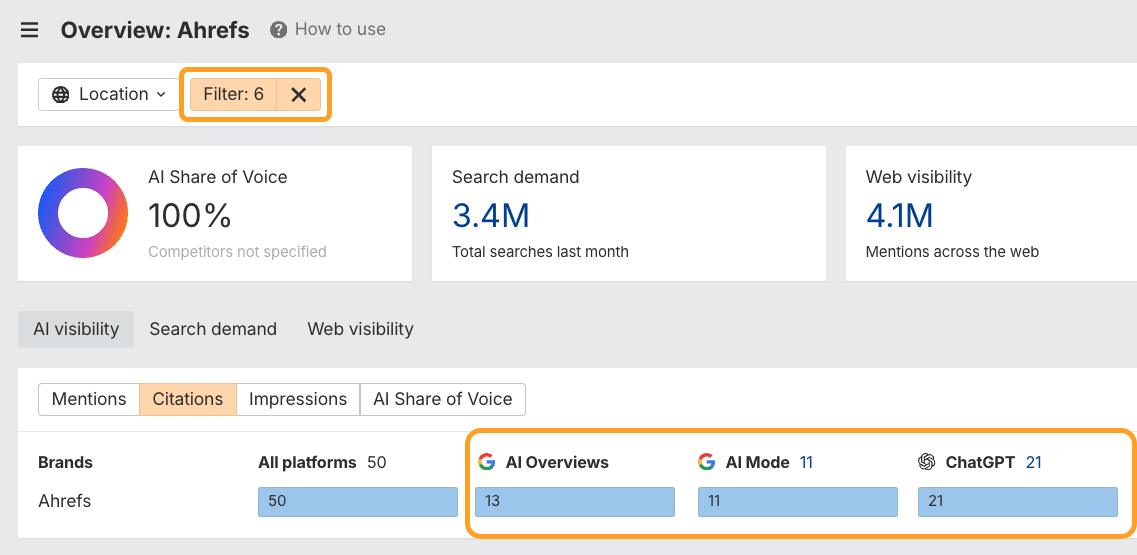

Usando o Brand Radar, Xibeijia extraiu alguns milhões de URLs citados nas visões gerais de IA.

Ela então recuperou o histórico HTML do nosso banco de dados do rastreador, rotulando se cada URL continha , and spotted the date that schema presence transitioned from “False” to “True”.

This left her with 1,885 pages that introduced JSON-LD between August 2025 and March 2026.

Finally, to analyze all of that data, she used Agent A, our new AI marketing agent.

For each page Xibieijia knew two key dates:

For each page Xibieijia knew two key dates:

- The last day our crawler checked the page and found no JSON-LD

- The first day our crawler detected JSON-LD on the page

Where schema might still matter: pages not yet cited by AI

There’s one important thing you need to know about this data: we studied pages that were already being cited heavily by AI. Every page in the dataset had 100+ AI Overview citations in February 2025, before any schema was added. These pages were already inside the consideration set, being crawled and surfaced by LLMs. If a page is already getting picked up, our data suggests that adding schema isn’t going to push it higher. But for pages that aren’t being seen by AI systems at all, schema markup might still play a role in helping them get crawled, parsed, or indexed in the first place. Our study can’t speak to that directly, but a recent experiment from searchVIU answers a related question. They tested whether five major AI systems (ChatGPT, Claude, Perplexity, Gemini, and Google AI Mode) actually used schema markup when fetching a page in real-time. Spoiler: none of them did. During direct retrieval, every system extracted only visible HTML content. JSON-LD, hidden Microdata, and hidden RDFa were all ignored. A few other points to flag, and some questions worth testing next:- Pages that add JSON-LD often change other things at the same time (e.g. links, content, technical fixes). We can’t fully separate schema from these kinds of co-occurrences.

- We pooled all schema types together. Article, FAQ, Product, HowTo, Organization. It’s possible some types help more than others. This may be worth digging into.

- We measured 30 days post-treatment. If JSON-LD has a slow-burn effect, a 60- or 90-day window might reveal more growth.

- We studied JSON-LD—the most widely used schema format. Other formats exist (Microdata and RDFa), but we haven’t yet tested them.

- We only looked at schema in the page’s HTML, not schema injected via JavaScript. AI crawlers appear to treat the two differently. ¹

- The small AI Overview decline is real but unexplained. Treated pages dropped about 4.6% more than matched controls, and we don’t know why. A follow-up study could look at whether specific schema types or specific content types account for the gap.

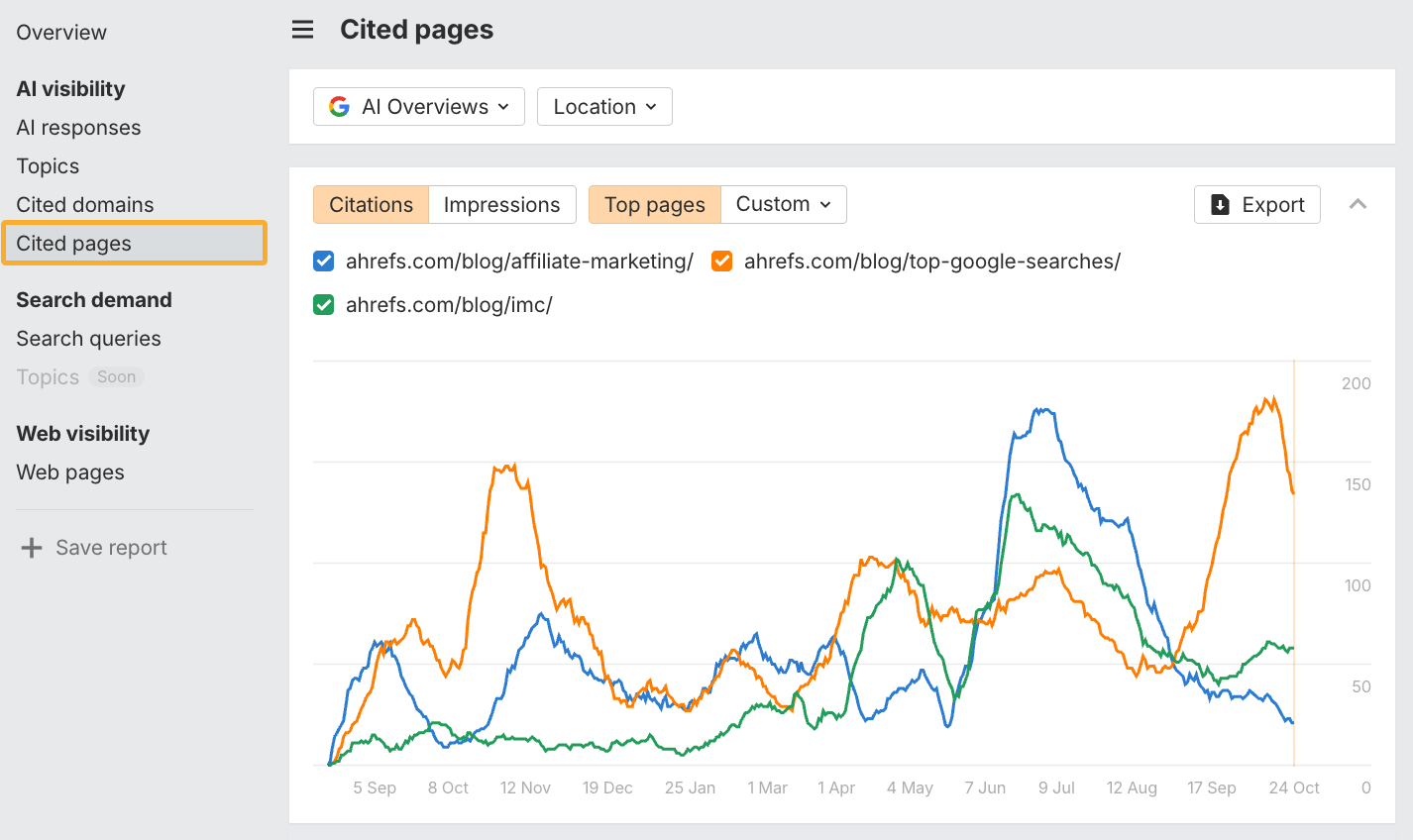

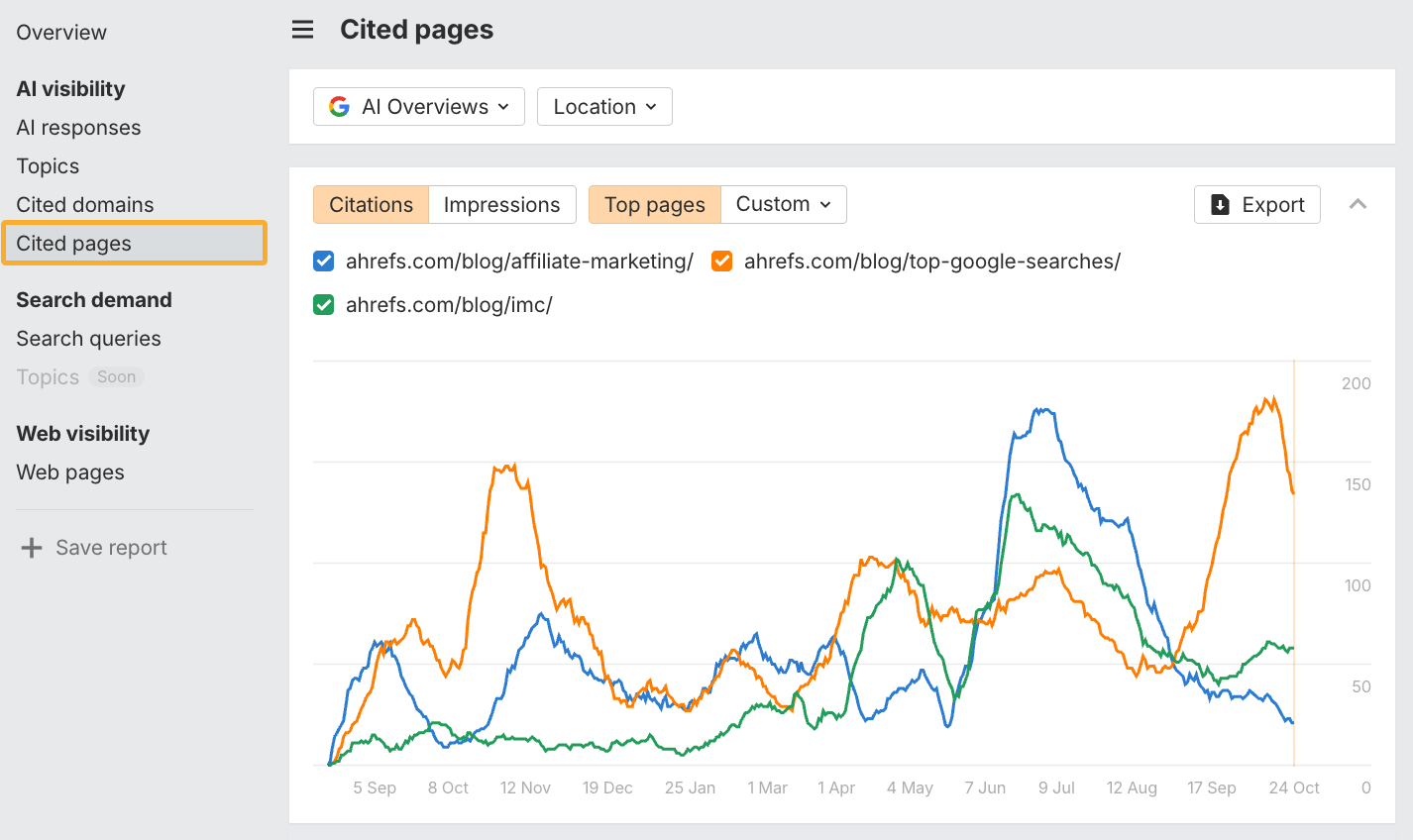

- Pick 5–10 test pages where you plan to add JSON-LD. Ideally pages already getting some AI citations, so you have a baseline (pages with zero citations make it harder to tell whether schema did nothing, or whether the page just wasn’t going to get cited either way). You can check this in the Cited Pages report.

- Pick 5–10 control pages with similar citation levels that you’re not adding schema to. This is what separates “schema did something” from “AI Overviews shifted for everyone that month.”

- Record baseline citations for both groups across AI Overview, AI Mode, and ChatGPT in Brand Radar. Just apply URL filters to isolate those citation numbers.

- Add schema to your test pages and note the date. Don’t change anything else on those pages during the test window.

- Compare both groups after 30 days (or longer if you can). The question is: “did treated pages go up more than control pages did?”